Apple présente UniGen‑1.5, un modèle multimodal capable de comprendre, générer et éditer des images au sein d’un seul système.

Le premier travail, UniGen, a été publié en mai 2025 dans l’étude « UniGen: Enhanced Training & Test-Time Strategies for Unified Multimodal Understanding and Generation » (arXiv). En novembre 2025, la suite « UniGen‑1.5: Enhancing Image Generation and Editing through Reward Unification in Reinforcement Learning » (arXiv) ajoute l’édition d’images et revoit la stratégie d’entraînement.

UniGen‑1.5, l’essentiel

- Modèle unique pour la compréhension, la génération et l’édition d’images.

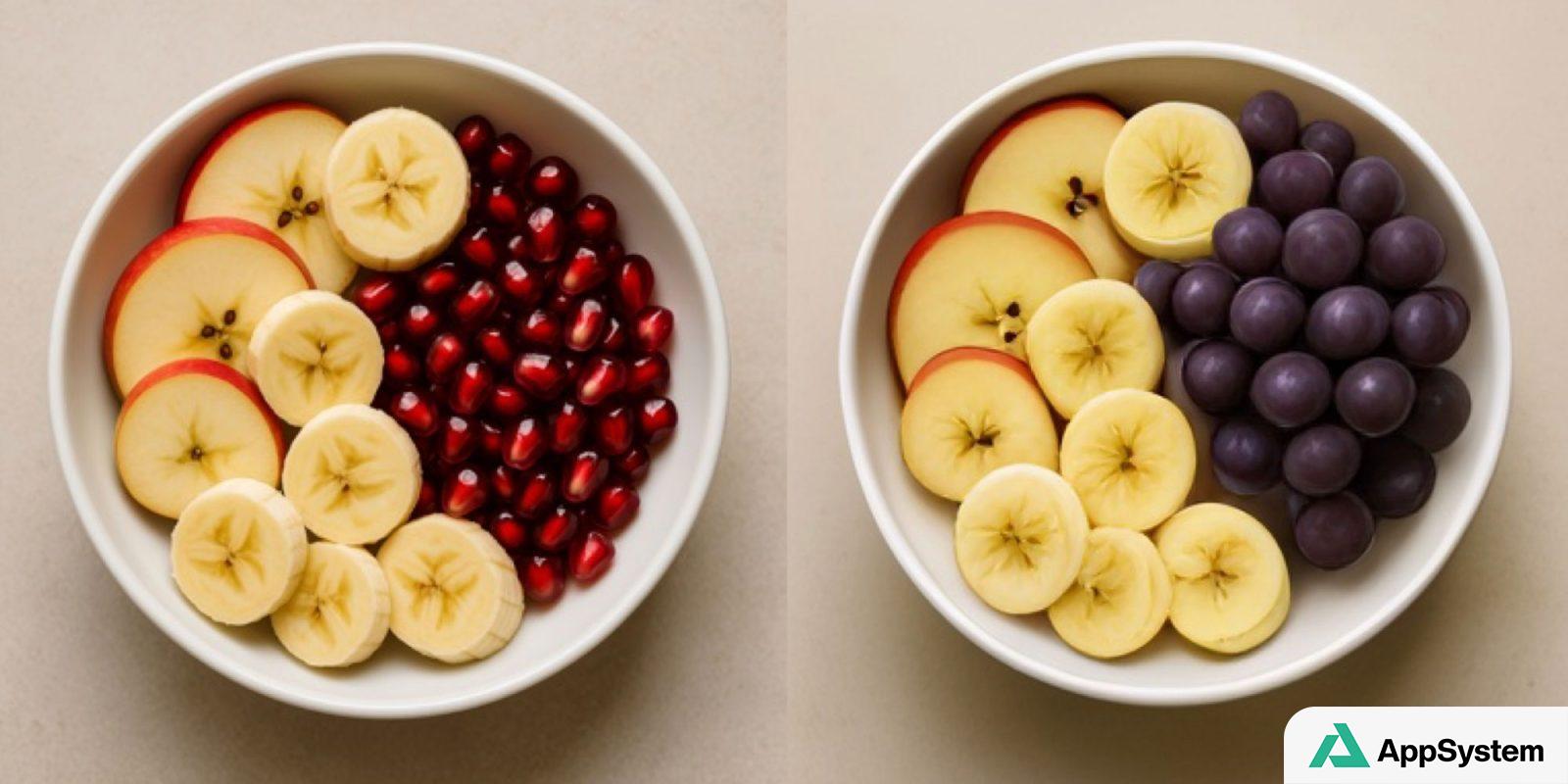

- Nouvelle étape post‑entraînement, Edit Instruction Alignment (EIA), pour mieux interpréter des consignes d’édition fines ou complexes.

- Récompense unifiée en apprentissage par renforcement pour la génération et l’édition, malgré l’amplitude variable des modifications.

- Résultats compétitifs sur les benchmarks : 0,89 sur GenEval, 86,83 sur DPG‑Bench ; score global de 4,31 sur ImgEdit, au‑dessus de méthodes récentes comme BAGEL et BLIP3o, supérieur à OminiGen2 et comparable à des modèles propriétaires comme GPT‑Image‑1.

- Limites actuelles : rendu de texte peu fiable et incohérences d’identité dans certains cas.

Ce qui change dans l’entraînement

Les chercheurs constatent que, malgré un affinage supervisé, le modèle peine à saisir certaines instructions d’édition lorsque les changements sont subtils ou très spécifiques. UniGen‑1.5 introduit donc l’Edit Instruction Alignment : une étape légère post‑SFT où le système apprend d’abord à déduire une description textuelle détaillée de l’image cible à partir de l’image d’origine et de l’instruction. Cette représentation sémantique sert de pivot avant la génération finale.

Vient ensuite l’apprentissage par renforcement avec une récompense unifiée pour la génération et l’édition. Ce choix, central dans l’étude, permet d’évaluer de manière cohérente des modifications allant du léger ajustement à la transformation complète, et d’améliorer la fidélité aux consignes tout en préservant la qualité visuelle.

Résultats et limites

Sur des benchmarks couvrant suivi des instructions, qualité visuelle et difficulté des edits, UniGen‑1.5 établit une base solide pour les modèles multimodaux unifiés. Des échecs persistent toutefois pour la génération de texte (manque de contrôle des détails structurels) et la constance d’identité, avec des variations visibles sur des textures ou des couleurs.

L’étude complète est disponible sur arXiv.