Les appareils Apple proposent une transcription de la parole en texte d’une rapidité et d’une précision remarquables dans les versions bêta pour développeurs, selon un test récent.

Alors que la majorité des applications de transcription s’appuient sur le modèle Whisper d’OpenAI, Apple a intégré ses propres frameworks de transcription dans iOS 26 et les autres versions bêta pour développeurs. Les premiers tests montrent que la précision équivaut à celle de Whisper, tout en étant plus de deux fois plus rapide.

Les capacités de dictée intégrées de vos appareils Apple sont gérées par le framework de reconnaissance vocale d’Apple. Dans les nouvelles versions bêta, les développeurs peuvent tirer parti des modules SpeechAnalyzer et SpeechTranscriber dans leurs applications.

Utilisez le framework de reconnaissance vocale pour reconnaître les mots prononcés dans un audio enregistré ou en direct. Le support de dictée du clavier utilise la reconnaissance vocale pour convertir l’audio en texte. Ce framework peut être utilisé indépendamment du clavier pour des tâches telles que les commandes verbales ou la dictée de texte.

John Voorhees de MacStories a demandé à son fils de créer un outil en ligne de commande pour tester cette capacité, et les résultats se sont avérés impressionnants.

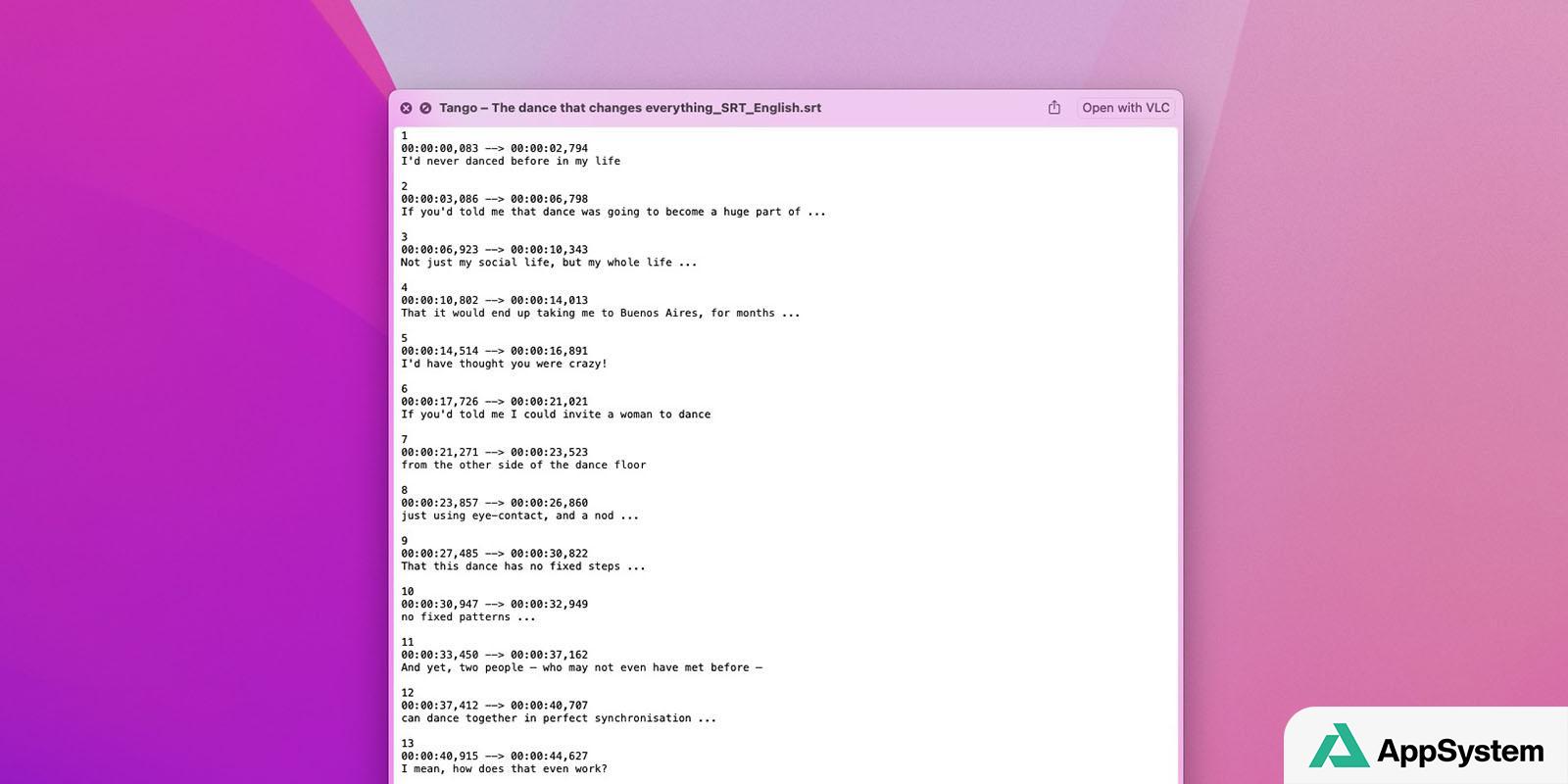

Avec un test sur une vidéo de 34 minutes, comparée aux applications populaires MacWhisper et VidCap, les modules d’Apple ont non seulement égalé leur précision, mais ont également offert une transcription en une fraction du temps requis par MacWhisper, doté du modèle Large V3 Turbo : 0:45 pour l’outil d’Apple contre 1:41 pour MacWhisper. Selon lui, ceci représente une amélioration significative pour les transcriptions en masse ou régulières, comme celles des étudiants pour leurs prises de notes en cours.

Si vous utilisez la version bêta de macOS Tahoe, vous pouvez essayer cet outil avec Yap sur GitHub.