Alors que nombre d’utilisateurs s’appuient désormais sur l’IA pour des tâches de rédaction comme les brouillons d’e-mails ou les résumés de documents, un problème persiste : les résultats sont souvent trop impersonnels. Même avec des indications très détaillées, les modèles comme ChatGPT ou Gemini peinent à rendre compte du ton individuel de chaque utilisateur sans ajustements manuels conséquents. Apple envisage une solution potentielle.

Dans un nouvel article de recherche intitulé Aligning LLMs by Predicting Preferences from User Writing Samples, qui sera présenté à la conférence internationale sur l’apprentissage automatique (ICML 2025) le mois prochain, les chercheurs d’Apple dévoilent PROSE, une technique conçue pour aider les modèles de langue à mieux deviner et adopter les préférences d’écriture uniques d’un utilisateur en apprenant directement à partir de ses échantillons de texte antérieurs.

Comment fonctionne PROSE

PROSE (Preference Reasoning by Observing and Synthesizing Examples) va au-delà des méthodes d’alignement traditionnelles actuelles, comme la conception de prompts ou l’apprentissage par renforcement basé sur les retours humains. Ici, l’IA crée un profil interne et interprétable du style d’écriture de l’utilisateur.

Plutôt que de demander à l’utilisateur de fournir des guides de style ou de corriger d’innombrables brouillons, PROSE fonctionne en deux étapes :

- Affinement itératif : L’IA compare constamment ses réponses générées avec des exemples réels de l’utilisateur, ajustant sa « description des préférences » interne jusqu’à produire un texte qui correspond étroitement au style de l’utilisateur.

- Vérification de la cohérence : Pour éviter de se fixer sur un seul exemple, qui pourrait être non représentatif du style global de l’utilisateur, l’IA vérifie que toute préférence inférée (comme « utiliser des phrases courtes » ou « commencer par une blague ») est valide à travers plusieurs échantillons d’écriture.

En gros, PROSE construit un profil de style évolutif, le teste sur plusieurs exemples d’utilisateur et l’utilise comme base pour les générations futures.

Pourquoi cela compte pour Apple Intelligence

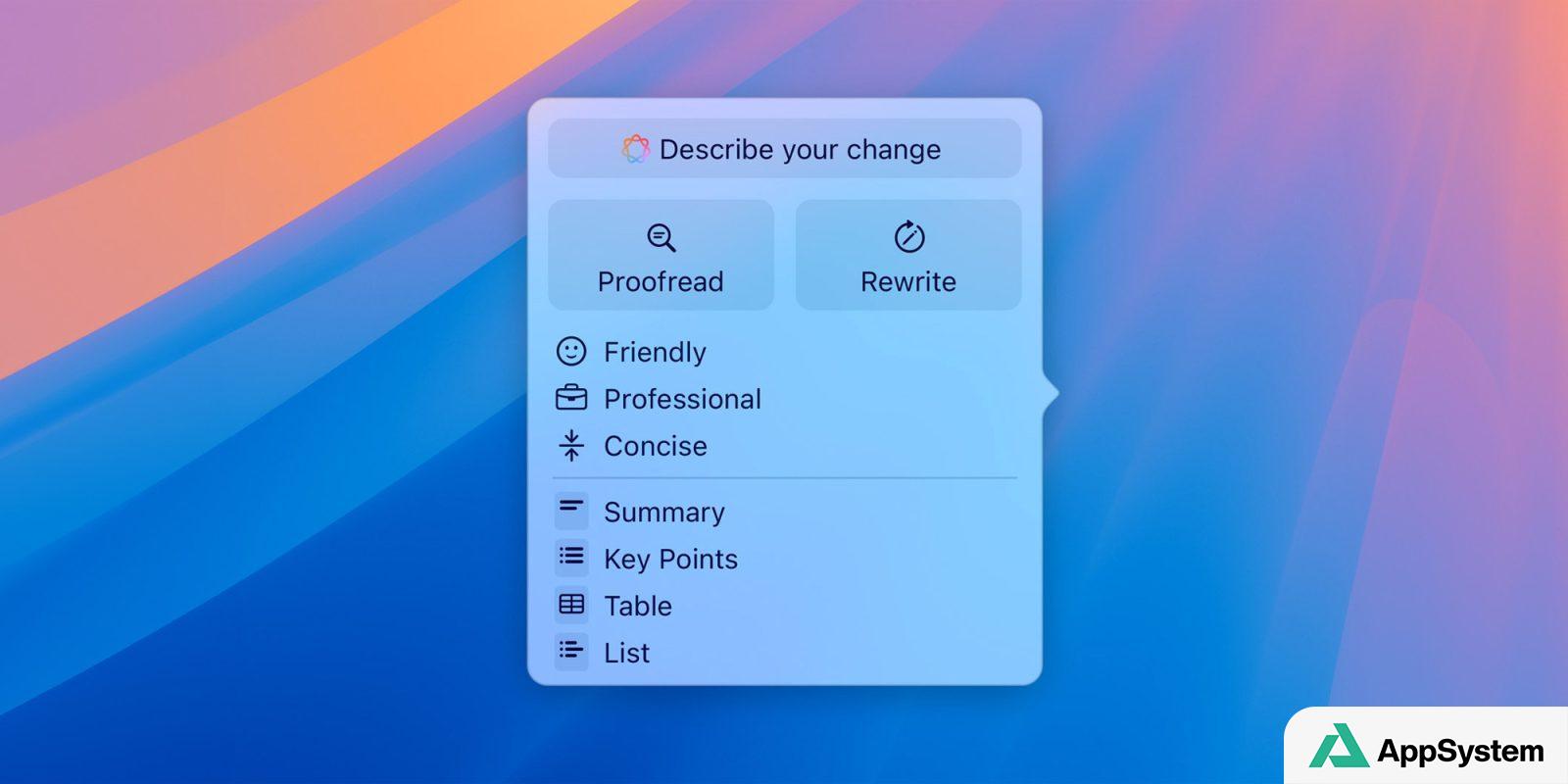

Bien que le document ne mentionne pas explicitement les produits ou services Apple, le lien est évident. À mesure qu’Apple s’engage davantage dans des fonctionnalités d’assistants plus personnalisées, des techniques comme PROSE pourraient jouer un rôle majeur pour que l’intelligence d’Apple rédige des textes qui reflètent mieux chaque utilisateur.

Avec la possibilité offerte aux développeurs d’accéder directement aux modèles locaux d’Apple grâce au nouveau cadre des modèles de base, on peut facilement imaginer un futur où n’importe quelle application pourrait intégrer un assistant d’écriture personnalisé à l’échelle du système.

Un nouveau standard est aussi mis en place

Dans l’étude, Apple introduit également un nouveau jeu de données de référence appelé PLUME (Preference Learning from User Emails and Memos) pour évaluer les techniques d’alignement du style d’écriture comme PROSE. Cela remplace l’ancien dataset PRELUDE et vise à résoudre des problèmes courants liés aux tests de personnalisation des modèles de langage, tels que les définitions de préférences superficielles.

En utilisant PLUME, les chercheurs ont comparé PROSE à des approches antérieures, telles qu’une autre méthode d’apprentissage des préférences nommée CIPHER, et les techniques d’apprentissage contextuel standard. Le résultat ? PROSE a surpassé CIPHER de 33 % sur des métriques clés et a même battu les résultats du contextual learning standard lorsque couplé avec des modèles avancés comme GPT-4o.

Fait intéressant, l’étude suggère également que la combinaison de PROSE avec l’apprentissage contextuel offre le meilleur des deux mondes, avec une amélioration de jusqu’à 9 % par rapport à l’apprentissage contextuel seul.

Le projet PROSE s’inscrit dans une tendance plus large de la recherche en IA : rendre les assistants non seulement plus intelligents, mais aussi plus personnels. Que ce soit via un ajustement local, la modélisation des préférences ou les prompts contextuels, la course est lancée pour combler l’écart entre les sorties génériques des modèles de langue et la voix unique de chaque utilisateur.