Des chercheurs d’Apple ont mis au point un modèle d’IA capable de reconstruire un objet en 3D à partir d’une image unique, tout en conservant des effets d’éclairage réalistes — reflets, brillances spéculaires et variations liées à l’angle de vue.

Contexte : le rôle de l’espace latent

La notion d’« espace latent » (ou espace d’embedding) s’est imposée comme un élément central de nombreux modèles modernes. L’idée consiste à convertir des informations en représentations numériques compactes, organisées dans un espace multidimensionnel, afin de mesurer des proximités et de faciliter la génération de contenu.

Si cette approche est souvent illustrée avec du texte, le même principe s’applique à d’autres données — notamment des images et, dans ce cas précis, des indices utiles à la reconstruction 3D.

LiTo : géométrie et apparence dépendante du point de vue

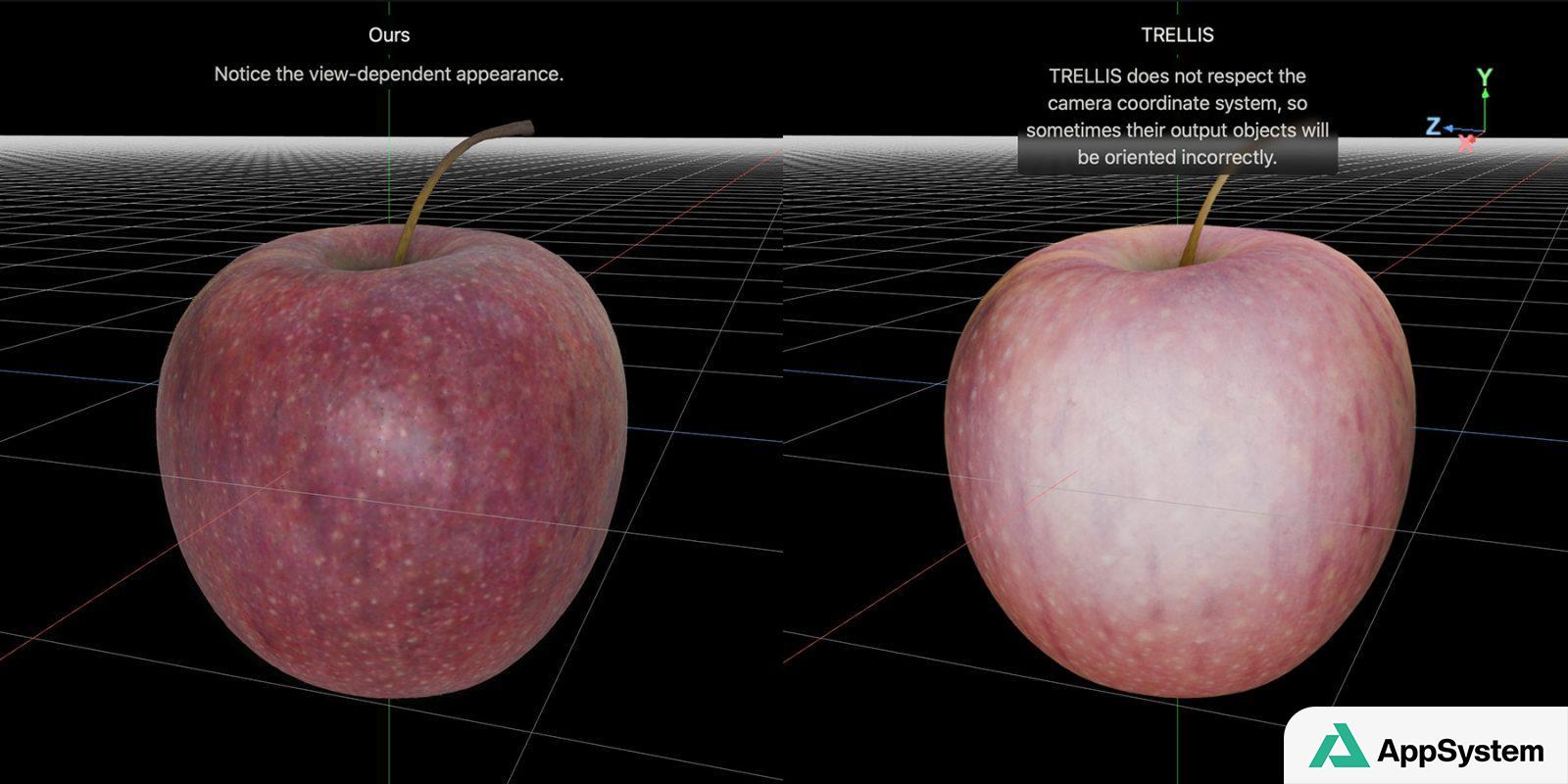

Dans une étude intitulée LiTo: Surface Light Field Tokenization, Apple décrit une « représentation 3D en espace latent » qui modélise conjointement la géométrie d’un objet et son apparence dépendante de la direction d’observation. Objectif : reproduire des effets réalistes qui changent selon l’angle, comme les reflets de type Fresnel ou les rehauts spéculaires, là où nombre d’approches se limitent à une apparence diffuse, dite indépendante du point de vue.

Principe de fonctionnement

- Encodage : un encodeur compresse l’information de l’objet dans un ensemble réduit de vecteurs latents, résumant à la fois la forme et la manière dont la lumière interagit avec la surface.

- Décodage : un décodeur reconstruit ensuite l’objet 3D et génère une apparence cohérente selon différents angles de vue, en intégrant les variations d’éclairage.

L’élément notable du travail présenté est la capacité à obtenir ce résultat à partir d’une seule image, alors que les méthodes classiques s’appuient fréquemment sur plusieurs vues pour reconstruire la géométrie.

Entraînement : vues multiples, éclairages variés, sous-échantillonnage

Pour l’entraînement, les chercheurs ont utilisé des milliers d’objets rendus depuis 150 angles de vue différents, sous trois conditions d’éclairage. Plutôt que d’ingérer systématiquement l’ensemble des données, le système sélectionne aléatoirement de petits sous-ensembles d’échantillons, les compresse en espace latent, puis entraîne le décodeur à reconstruire l’objet complet et son apparence à travers les angles et éclairages.

Une fois cette représentation apprise, un autre modèle est entraîné à prédire, à partir d’une image unique, le code latent correspondant. Le décodeur peut alors régénérer l’objet 3D, ainsi que la manière dont son rendu varie avec le point de vue.

Le projet public d’Apple, avec des comparaisons (notamment face à un modèle nommé TRELLIS), est accessible ici : apple.github.io/ml-lito. L’article scientifique complet est disponible sur arXiv : arxiv.org/abs/2603.11047.